¿Qué es una matriz? [Nota: La traducción preserva el término matemático "matriz", que es ampliamente reconocido en español.]

Explore los fundamentos y conceptos avanzados de las matrices, incluyendo sus tipos, operaciones y aplicaciones en el mundo real en IA, economía, gráficos e ingeniería.

Entendiendo lo Básico de las Matrices

Antes de participar en operaciones complejas o aplicaciones, es vitalmente importante aprender sobre la estructura básica de las matrices y los conceptos fundamentales. Aquí, explorarás su definición formal, la interpretación de sus elementos y la relación con los sistemas de datos del mundo real.

Definición de una Matriz y su Orden

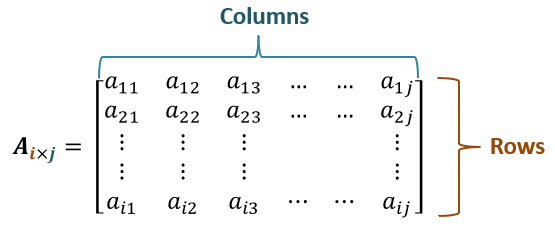

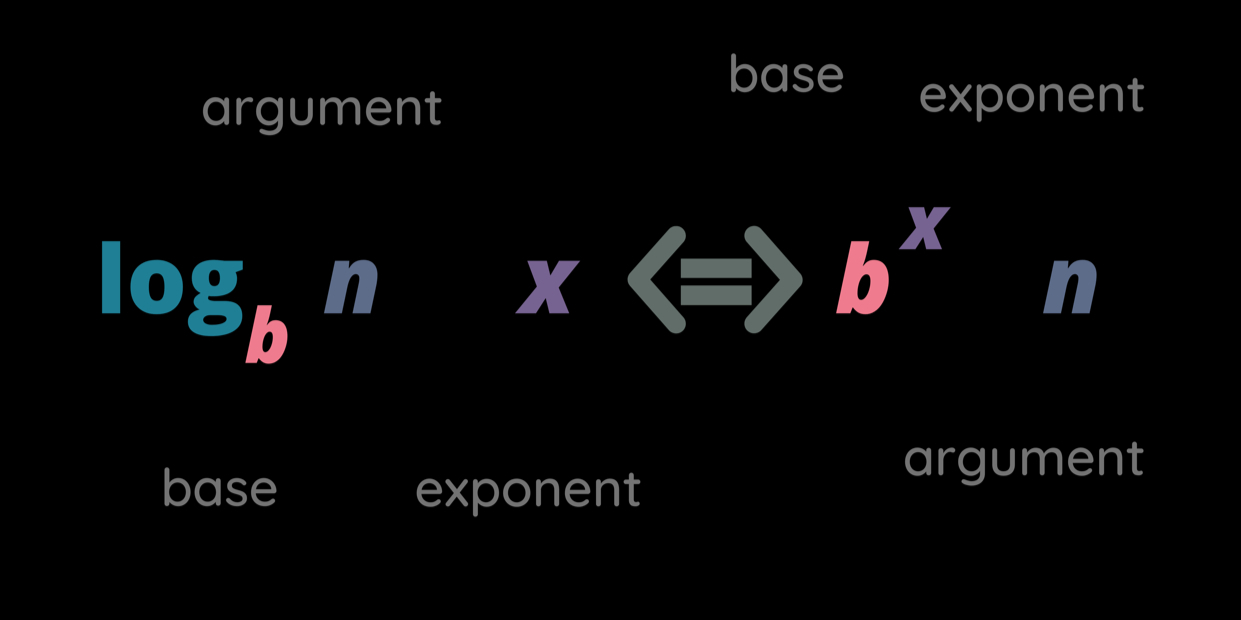

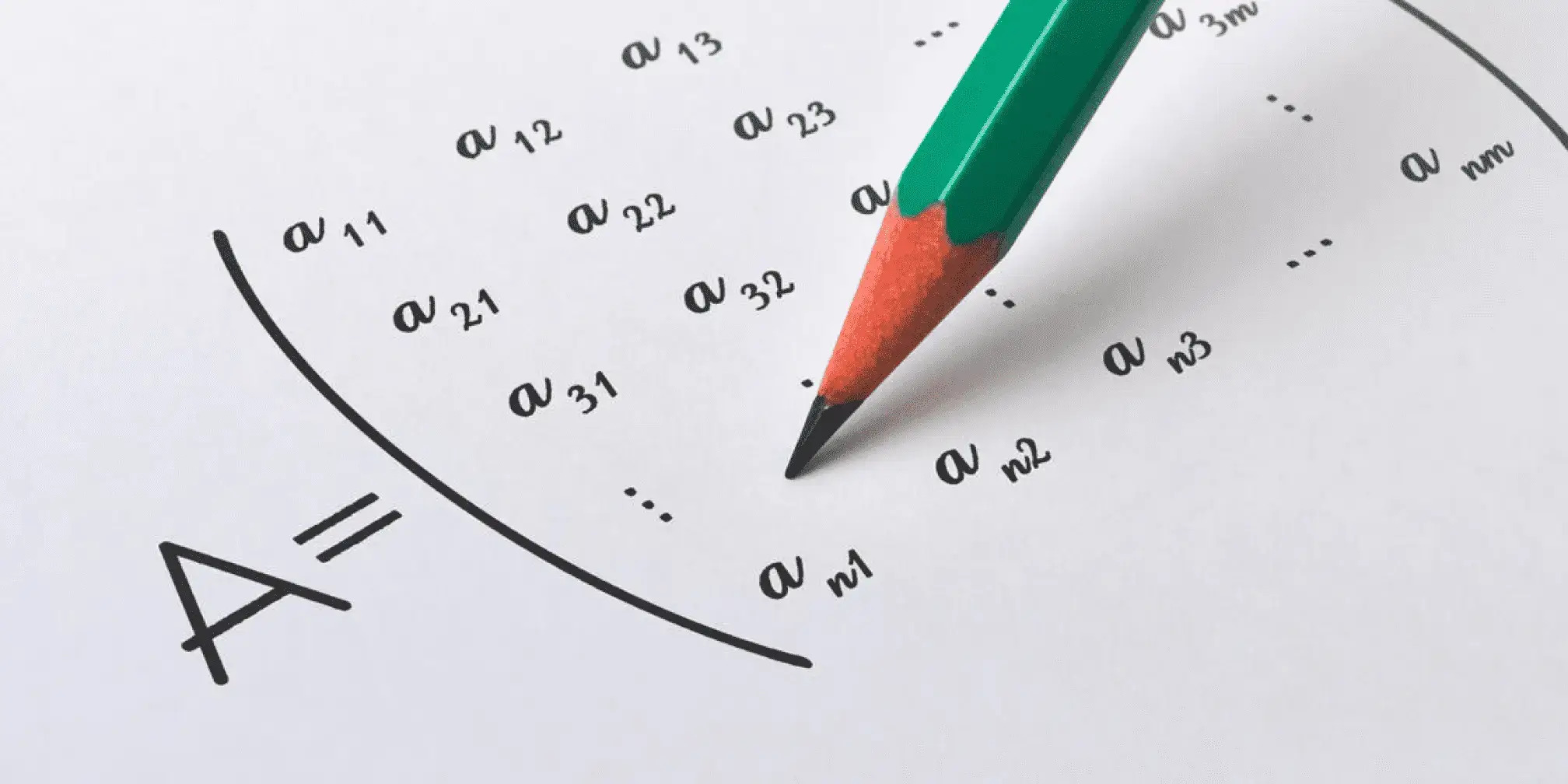

En pocas palabras, una matriz es un arreglo rectangular de números organizados en filas (entradas horizontales) y columnas (entradas verticales). Todos los números o valores dentro de la matriz se llaman elementos. Cada número se coloca sistemáticamente bajo índices específicos. Matemáticamente, una matriz se representa como:

\(A = \begin{bmatrix} a_{11} & a_{12} & \dots & a_{1n} \\ a_{21} & a_{22} & \dots & a_{2n} \\ \vdots & \vdots & \ddots & \vdots \\ a_{m1} & a_{m2} & \dots & a_{mn} \end{bmatrix}\)

Aquí:

- \(A\): El nombre de la matriz (letra mayúscula en inglés).

- \(a_{ij}\): El elemento de la matriz \(A\) en la fila \(i\) y columna \(j\).

- \(m\): El número de filas en la matriz.

- \(n\): El número de columnas en la matriz.

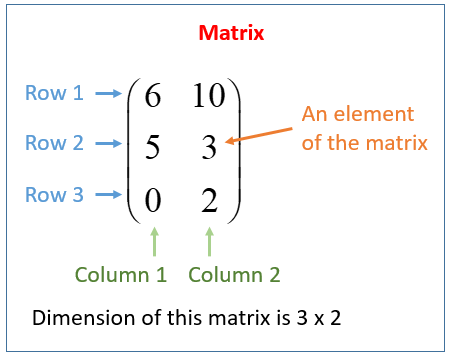

El orden de la matriz se denota como \(m \times n\), representando el número de filas y columnas. Por ejemplo, una matriz \(A\) con 2 filas y 3 columnas se dice que tiene un orden \(2 \times 3\).

Filas, Columnas y Elementos

Desglosemos estos componentes esenciales:

- Filas: Las filas en una matriz son las líneas horizontales de elementos. Para la matriz \(A\) de orden \(m \times n\), la \(i\)-ésima fila se escribe como \([a_{i1}, a_{i2}, \dots, a_{in}]\).

- Columnas: Las columnas en una matriz son las pilas verticales de elementos. Para la matriz \(A\), la \(j\)-ésima columna es \([a_{1j}, a_{2j}, \dots a_{mj}]^T\), donde \(T\) representa la transpuesta.

- Elementos: Cada número individual en la cuadrícula se llama elemento y se identifica de manera única por su posición \((i, j)\) dentro de la matriz. Por ejemplo, en una \(2 \times 3\) matriz \(B = \begin{bmatrix} 1 & 2 & 3 \\ 4 & 5 & 6 \end{bmatrix}\), \(b_{23} = 6\) porque es el elemento en la segunda fila y la tercera columna.

Analogía de Matrices en el Mundo Real

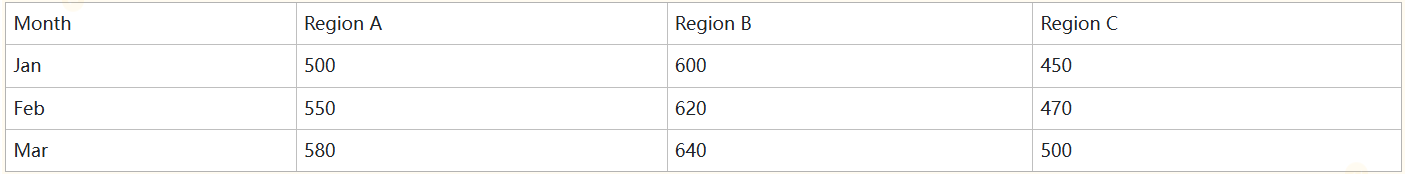

Imagina usar hojas de cálculo como Microsoft Excel. Una hoja de cálculo es una excelente analogía para entender las matrices, ya que está dividida de manera similar en filas y columnas, con cada celda conteniendo un valor. Por ejemplo:

Esta tabla puede representarse como una \(3 \times 4\) matriz, donde cada celda se convierte en un elemento. Tales sistemas son útiles para gestionar datos estructurados en industrias como finanzas, negocios y logística.

Tipos de Matrices

Las matrices pueden presentarse en diferentes formas, cada una con su estructura y propiedades específicas. Comprenderlas es vital ya que cada tipo cumple un papel distinto cuando se aplican en cálculos matemáticos o en diversos campos.

Tipos Clásicos de Matrices

Algunas de las matrices más comunes incluyen:

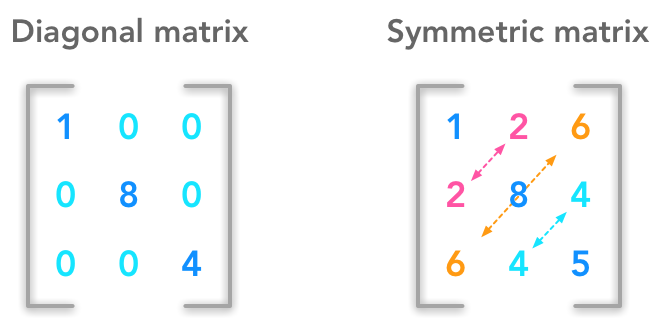

Matriz Simétrica

Una matriz cuadrada \(A\) es simétrica si el elemento \(a_{ij}\) es igual al elemento correspondiente \(a_{ji}\). En otras palabras, \(A = A^T\) (donde \(A^T\) es la transpuesta de \(A\)). Un ejemplo es:

\(A = \begin{bmatrix} 1 & 2 & 3 \\ 2 & 4 & 5 \\ 3 & 5 & 6 \end{bmatrix}\)

Aquí, observa que \(a_{12} = a_{21} = 2\), \(a_{13} = a_{31} = 3\), y así sucesivamente. Las matrices simétricas desempeñan un papel significativo en problemas de optimización y en cálculos relacionados con valores propios.

Matriz Antisimétrica

Para que una matriz cuadrada \(A\) sea antisimétrica, debe cumplir la relación \(a_{ij} = -a_{ji}\) para todos \(i\) y \(j\), y sus elementos diagonales siempre deben ser cero. Por ejemplo:

\(A = \begin{bmatrix} 0 & -3 & 2 \\ 3 & 0 & -7 \\ -2 & 7 & 0 \end{bmatrix}\)

Las matrices antisimétricas a menudo surgen en física, particularmente en la representación de sistemas rotacionales.

Matriz Diagonal

Una matriz diagonal se caracteriza por tener todos sus elementos no diagonales iguales a cero. Por ejemplo:

\(A = \begin{bmatrix} 4 & 0 & 0 \\ 0 & 5 & 0 \\ 0 & 0 & 6 \end{bmatrix}\)

Tales matrices simplifican operaciones computacionales como la inversión de matrices y el cálculo de valores propios.

Matriz Identidad

La matriz identidad, denotada por \(I\), es una matriz diagonal especial donde todos los elementos diagonales son iguales a 1, mientras que todos los demás son cero:

\(I = \begin{bmatrix} 1 & 0 & 0 \\ 0 & 1 & 0 \\ 0 & 0 & 1 \end{bmatrix}\)

La matriz identidad actúa como la identidad multiplicativa en el álgebra de matrices, significando que \(IA = AI = A\) para cualquier matriz cuadrada \(A\).

Tipos Avanzados

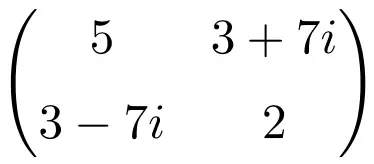

Matriz Hermitiana

Una matriz \(A\) es hermitiana si es igual a su propia transpuesta conjugada, es decir, \(A = A^\dagger\). Por ejemplo:

\(A = \begin{bmatrix} 2 & i \\ -i & 3 \end{bmatrix}\)

Tales matrices aparecen comúnmente en la mecánica cuántica.

Matriz Ortogonal

Una matriz cuadrada \(A\) es ortogonal si su transpuesta es igual a su inversa, es decir, \(A A^T = A^T A = I\). Estas matrices son útiles en transformaciones y rotaciones en las que se debe preservar la longitud unitaria.

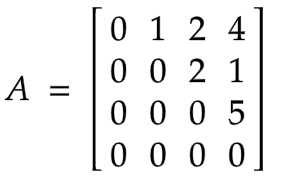

Matriz Nilpotente

Una matriz cuadrada \(A\) es nilpotente si existe un entero \(p > 0\) tal que \(A^p = 0\). Por ejemplo:

\(A = \begin{bmatrix} 0 & 1 \\ 0 & 0 \end{bmatrix}, \quad A^2 = \begin{bmatrix} 0 & 0 \\ 0 & 0 \end{bmatrix}\)

Las matrices nilpotentes suelen aparecer en aplicaciones avanzadas de álgebra lineal.

Matrices Relacionales

Las matrices relacionales son particularmente importantes en campos aplicados como la teoría de grafos y la ciencia de datos. Por ejemplo, una matriz de adyacencia representa las conexiones entre los vértices en un grafo. Si un grafo tiene los vértices \(V_1, V_2,\) y \(V_3\), y aristas que conectan \(V_1\) con \(V_2\) y \(V_2\) con \(V_3\), la matriz de adyacencia es:

\(A = \begin{bmatrix} 0 & 1 & 0 \\ 1 & 0 & 1 \\ 0 & 1 & 0 \end{bmatrix}\)

Las matrices relacionales simplifican tareas como encontrar caminos más cortos y analizar redes en informática.

Operaciones Clave en Matrices

Una de las razones esenciales por las que las matrices se utilizan tan ampliamente es por las operaciones que se pueden realizar en ellas. Estas operaciones se utilizan para la manipulación de datos: resolver sistemas de ecuaciones y realizar transformaciones en varios dominios como álgebra lineal y gráficos por computadora.

Operaciones Aritméticas Básicas

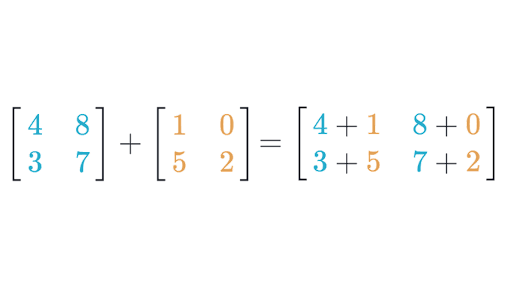

Adición y Sustracción de Matrices

Las matrices con las mismas dimensiones se pueden sumar o restar fácilmente elemento por elemento. Si \(A\) y \(B\) son matrices del mismo orden \(m \times n\), entonces:

\((A + B)_{ij} = a_{ij} + b_{ij}, \quad (A - B)_{ij} = a_{ij} - b_{ij}\)

Por ejemplo:

\(A = \begin{bmatrix} 1 & 2 \\ 3 & 4 \end{bmatrix}, \quad B = \begin{bmatrix} 5 & 6 \\ 7 & 8 \end{bmatrix}\)

La adición de matrices da:

\(A + B = \begin{bmatrix} 1+5 & 2+6 \\ 3+7 & 4+8 \end{bmatrix} = \begin{bmatrix} 6 & 8 \\ 10 & 12 \end{bmatrix}\)

Del mismo modo, la sustracción de matrices daría:

\(A - B = \begin{bmatrix} 1-5 & 2-6 \\ 3-7 & 4-8 \end{bmatrix} = \begin{bmatrix} -4 & -4 \\ -4 & -4 \end{bmatrix}\)

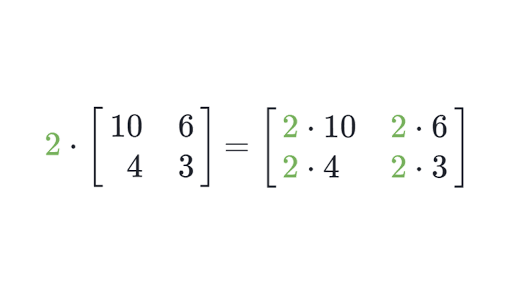

Multiplicación Escalar

Multiplicar una matriz por un escalar (un único número) implica simplemente multiplicar cada elemento de la matriz por ese escalar. Si \(k\) es un escalar y \(A\) es una matriz, la multiplicación escalar se define como:

\((kA)_{ij} = k \cdot a_{ij}\)

Por ejemplo, multiplicar \(A = \begin{bmatrix} 1 & 2 \\ 3 & 4 \end{bmatrix}\) por \(k = 3\) da:

\(3A = \begin{bmatrix} 3 \cdot 1 & 3 \cdot 2 \\ 3 \cdot 3 & 3 \cdot 4 \end{bmatrix} = \begin{bmatrix} 3 & 6 \\ 9 & 12 \end{bmatrix}\)

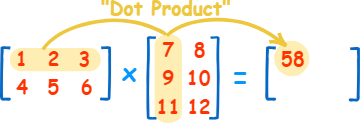

Multiplicación de Matrices

La multiplicación de matrices representa una de las operaciones fundamentales en álgebra lineal. Si \(A\) es una matriz de \(m \times n\) y \(B\) es una matriz de \(n \times p\), entonces el producto \(C = AB\) se define como:

\(c_{ij} = \sum_{k=1}^n a_{ik} b_{kj}, \quad \text{para todos } i = 1, \dots, m, \; j = 1, \dots, p\)

La matriz resultante \(C\) tendrá dimensiones \(m \times p\). Por ejemplo:

\(A = \begin{bmatrix} 1 & 2 \\ 3 & 4 \end{bmatrix}, \quad B = \begin{bmatrix} 5 & 6 \\ 7 & 8 \end{bmatrix}\)

Entonces, el producto \(AB\) se calcula como:

\(AB = \begin{bmatrix} (1)(5) + (2)(7) & (1)(6) + (2)(8) \\ (3)(5) + (4)(7) & (3)(6) + (4)(8) \end{bmatrix} = \begin{bmatrix} 19 & 22 \\ 43 & 50 \end{bmatrix}\)

Propiedades de la Multiplicación de Matrices

- Propiedad asociativa: \((AB)C = A(BC)\).

- Propiedad distributiva: \(A(B + C) = AB + AC\).

- No conmutativa: \(AB \neq BA\) en general.

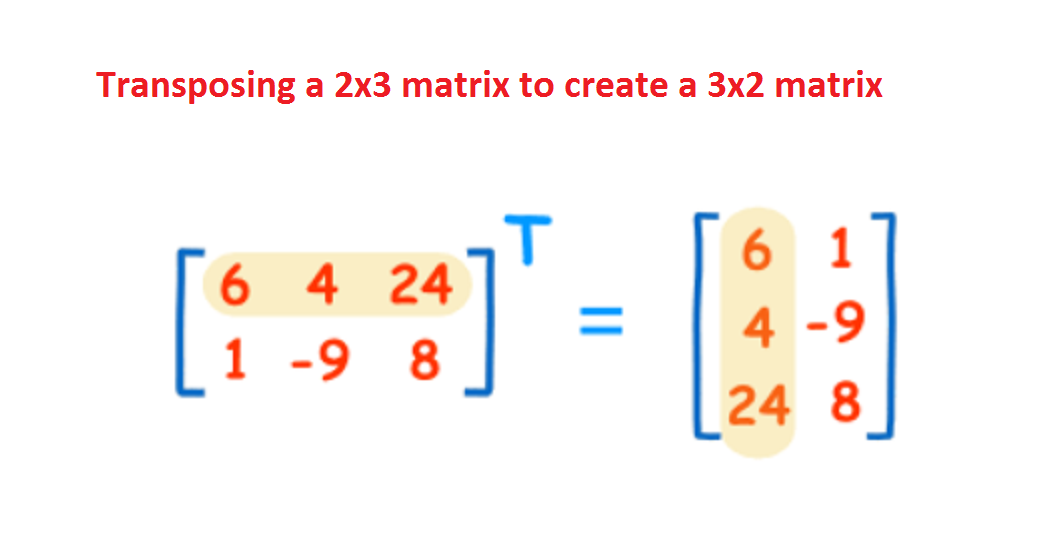

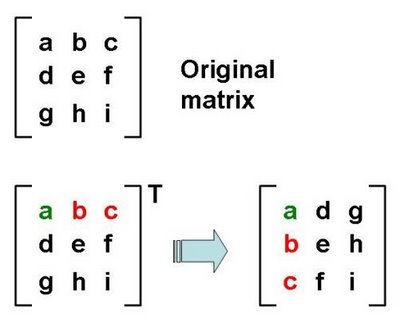

Transposición de Matrices

La transposición de una matriz \(A\), denotada por \(A^T\), se forma intercambiando filas y columnas de la matriz. Formalmente:

\((A^T)_{ij} = A_{ji}\)

Por ejemplo, si:

\(A = \begin{bmatrix} 1 & 2 \\ 3 & 4 \\ 5 & 6 \end{bmatrix}\)

Entonces su transposición es:

\(A^T = \begin{bmatrix} 1 & 3 & 5 \\ 2 & 4 & 6 \end{bmatrix}\)

Interacción de Matrices en Aprendizaje Automático

Las operaciones con matrices son fundamentales en los algoritmos de aprendizaje automático. Por ejemplo:

1. Regresión Lineal: El vector de peso \(\mathbf{w}\) en regresión lineal se calcula usando multiplicación e inversión de matrices:

\(\mathbf{w} = (\mathbf{X}^T \mathbf{X})^{-1} \mathbf{X}^T \mathbf{y}\)

2. Redes Neuronales: Las matrices se utilizan para representar pesos y activaciones. Dada una entrada \(\mathbf{x}\), pesos \(\mathbf{W}\) y sesgo \(\mathbf{b}\), la salida de una capa se computa como:

\(\mathbf{a} = \sigma(\mathbf{W} \mathbf{x} + \mathbf{b})\)

3. Descenso de Gradiente: Los gradientes calculados durante la optimización a menudo se representan y actualizan mediante operaciones con matrices, haciendo que estos procedimientos sean computacionalmente eficientes.

Determinantes y Valores Propios

Determinantes y valores propios proporcionan información crítica sobre las propiedades de las matrices. Estos conceptos son fundamentales para resolver sistemas lineales, comprender la geometría y analizar la estabilidad en sistemas dinámicos.

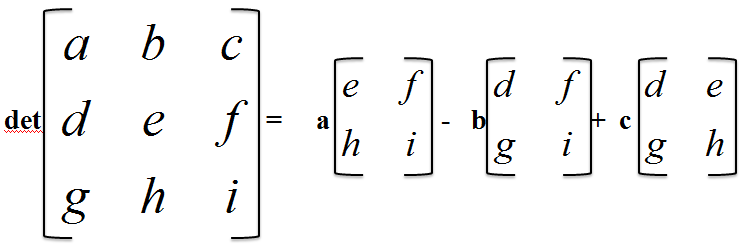

Determinantes de una Matriz

Para una matriz cuadrada \(A\), el determinante (denotado como \(\det(A)\) o \(|A|\)) es un valor escalar asociado con la matriz. Para una matriz \(2 \times 2\):

\(A = \begin{bmatrix} a & b \\ c & d \end{bmatrix}, \quad \det(A) = ad - bc\)

Por ejemplo:

\(A = \begin{bmatrix} 3 & 8 \\ 4 & 6 \end{bmatrix}, \quad \det(A) = (3)(6) - (8)(4) = 18 - 32 = -14\)

Para una matriz \(3 \times 3\), el determinante es:

\(A = \begin{bmatrix} a & b & c \\ d & e & f \\ g & h & i \end{bmatrix}, \quad \det(A) = a(ei - fh) - b(di - fg) + c(dh - eg)\)

Propiedades Clave de los Determinantes

1. Si \(\det(A) = 0\), entonces \(A\) es singular (no invertible).

2. Para matrices invertibles, \(\det(A^{-1}) = 1 / \det(A)\).

3. El determinante del producto de matrices satisface \(\det(AB) = \det(A) \det(B)\).

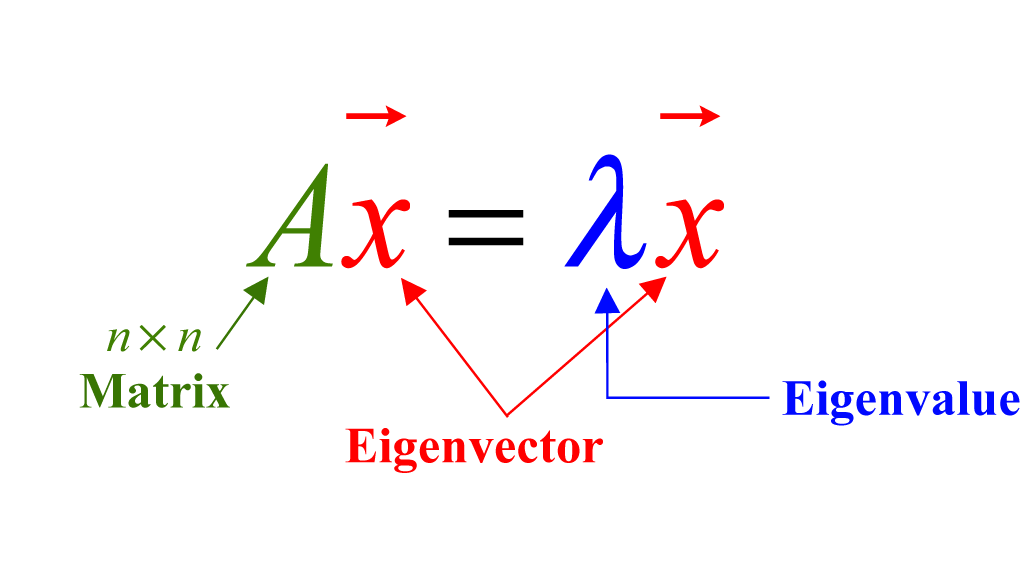

Valores Propios y Vectores Propios

Si \(A\) es una matriz \(n \times n\), la ecuación de los valores propios está dada por:

\(A \mathbf{v} = \lambda \mathbf{v}\)

Aquí:

- \(\lambda\): Un valor propio de la matriz \(A\).

- \(\mathbf{v}\): Un vector propio no nulo correspondiente a \(\lambda\).

Los valores propios se encuentran resolviendo la ecuación característica:

\(\det(A - \lambda I) = 0\)

Aplicaciones de los Valores Propios

- En sistemas mecánicos, los valores propios ayudan a predecir oscilaciones y estabilidad.

- En visión por computadora, los valores propios se utilizan para analizar características en la compresión de imágenes y el reconocimiento facial.

- En optimización, los vectores propios ayudan a construir componentes principales para el Análisis de Componentes Principales (PCA).

Aplicaciones de Matrices

Las matrices son ubicuas en la resolución de problemas complejos del mundo real porque pueden representar y procesar datos de manera estructurada de manera eficiente. Sus aplicaciones abarcan ingeniería, informática, economía, física, ciencias ambientales y otros campos.

Ingeniería e Informática

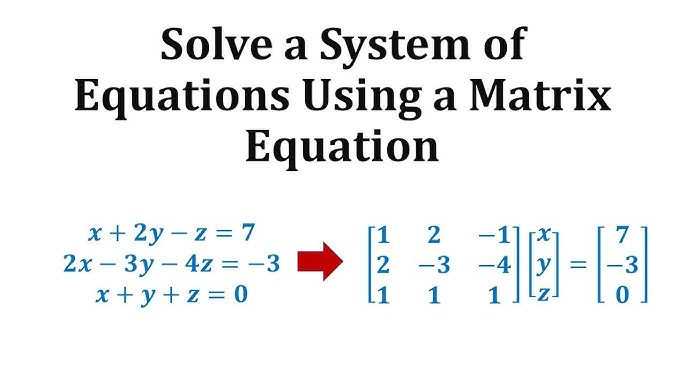

Sistemas de Ecuaciones Lineales

Una de las aplicaciones más importantes de las matrices en la ingeniería es la resolución de sistemas de ecuaciones lineales. Considere el sistema:

\(\begin{aligned} 2x + 3y &= 5 \\ 4x + y &= 11 \end{aligned}\)

Este sistema se puede representar en forma matricial:

\(\begin{bmatrix} 2 & 3 \\ 4 & 1 \end{bmatrix} \begin{bmatrix} x \\ y \end{bmatrix} = \begin{bmatrix} 5 \\ 11 \end{bmatrix}\)

Sea \(A = \begin{bmatrix} 2 & 3 \\ 4 & 1 \end{bmatrix}\), \(\mathbf{x} = \begin{bmatrix} x \\ y \end{bmatrix}\), y \(\mathbf{b} = \begin{bmatrix} 5 \\ 11 \end{bmatrix}\). Entonces, la solución se puede encontrar como:

\(\mathbf{x} = A^{-1} \mathbf{b}\)

Esta representación permite el uso de herramientas computacionales como la eliminación gaussiana o la descomposición LU para resolver eficientemente sistemas grandes.

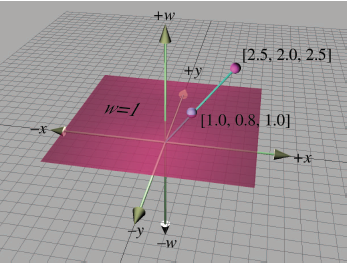

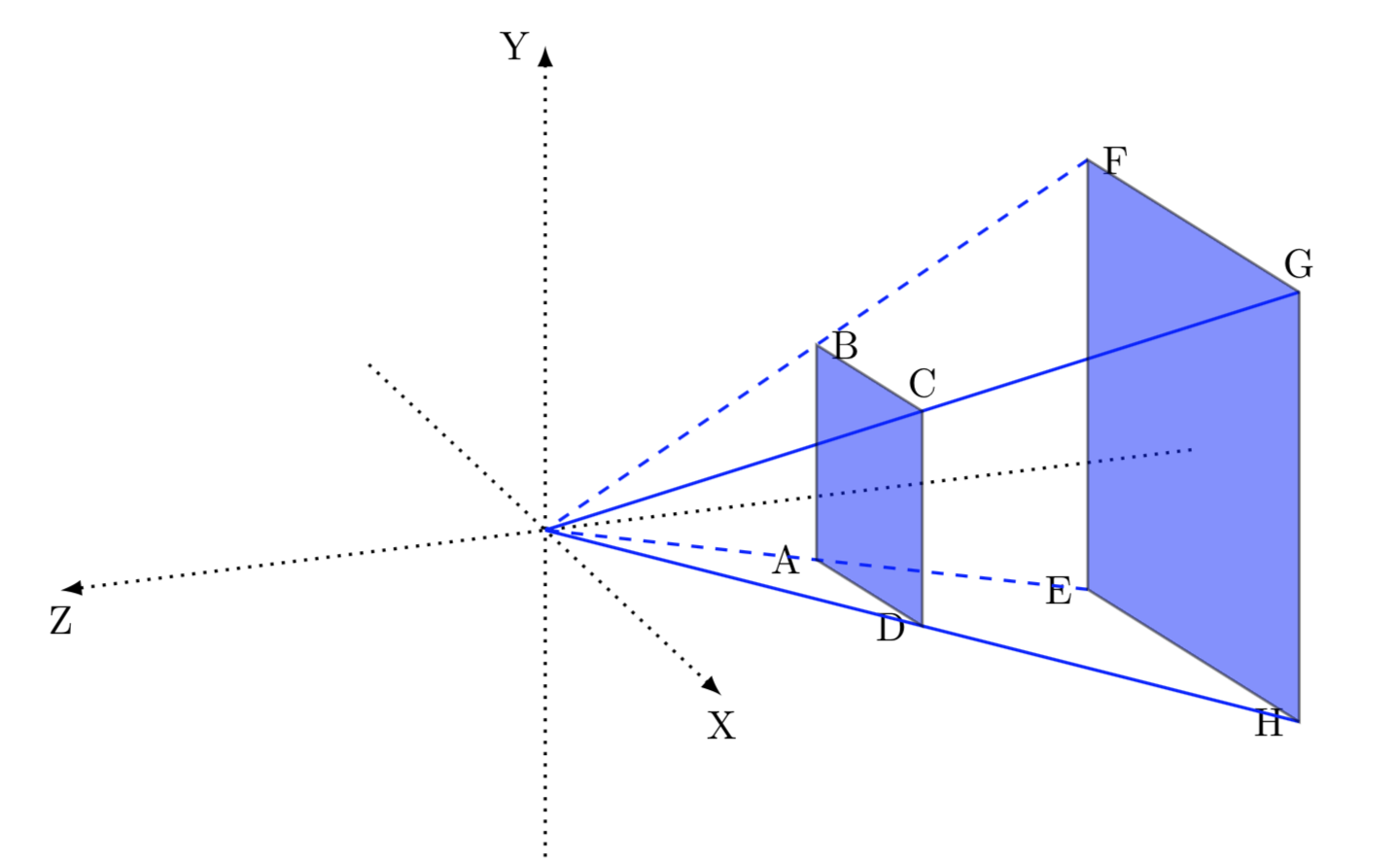

Gráficos por Computador y Transformaciones

En gráficos por computador, las matrices son críticas para realizar transformaciones como traslación, rotación, escalado y proyección en espacios 2D y 3D. Por ejemplo, para rotar un punto \(\mathbf{v}\) en 2D por un ángulo \(\theta\), la matriz de rotación \(R\) es:

\(R = \begin{bmatrix} \cos\theta & -\sin\theta \\ \sin\theta & \cos\theta \end{bmatrix}\)

El nuevo punto \(\mathbf{v}'\) tras la rotación se calcula como:

\(\mathbf{v}' = R \mathbf{v}\)

Este concepto forma la base de los juegos, animaciones y realidad virtual; las matrices de proyección usan este principio para renderizar escenas en 3D en pantallas 2D simulando perspectiva.

Economía y Ciencias Ambientales

Modelos de Insumo-Producto

En economía, las matrices modelan las interacciones entre sectores de una economía mediante el análisis de insumo-producto. Por ejemplo:

\(\mathbf{x} = A\mathbf{y}\)

Donde:

- \(\mathbf{x}\): Vector de salida de producción.

- \(A\): Matriz tecnológica, cuantificando cómo los sectores dependen entre sí.

- \(\mathbf{y}\): Vector de demanda final.

Este marco ayuda a los economistas a predecir cómo los cambios en un sector (p. ej., agricultura) pueden repercutir en otros sectores (p. ej., manufactura).

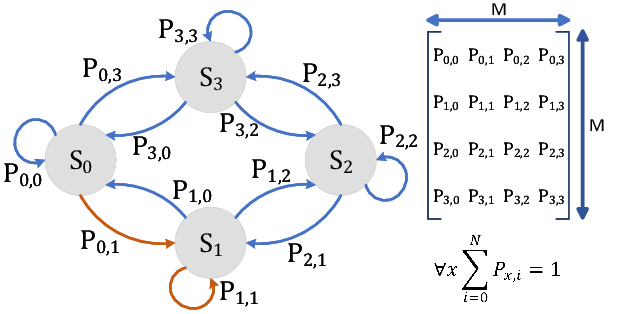

Modelado Ambiental

Las matrices también pueden desempeñar un papel invaluable en las ciencias ambientales para el análisis de sistemas ecológicos. Las cadenas de Markov las utilizan como representaciones de la transición entre estados (por ejemplo, poblaciones que se mueven entre hábitats).

Considere una matriz \(P\), donde \(p_{ij}\) es la probabilidad de transición del estado \(i\) al estado \(j\). Multiplicaciones repetidas como \(P^k\) proporcionan información sobre el equilibrio a largo plazo del ecosistema.

Mapeo de Perspectiva mediante Matrices

Las matrices controlan las transformaciones de perspectiva en óptica y cámaras manipulando proyecciones de imágenes. En visión por computadora, el mapeo de 3D a 2D de una cámara se puede modelar como:

\(P = K [R | t]\)

Aquí:

- \(K\): Matriz intrínseca que describe los parámetros internos de la cámara (p. ej., longitud focal).

- \(R\): Matriz de rotación, modelando la orientación de la cámara.

- \(t\): Vector de traslación que representa la ubicación de la cámara en la escena.

Esta técnica es esencial para tareas como la reconstrucción de modelos 3D, la navegación robótica y las aplicaciones de realidad aumentada.

Más Allá de las Matrices Clásicas: Innovaciones Modernas

A medida que los datos se vuelven más complejos en la ciencia y la tecnología modernas, las matrices tradicionales están evolucionando hacia estructuras más sofisticadas con nuevas aplicaciones.

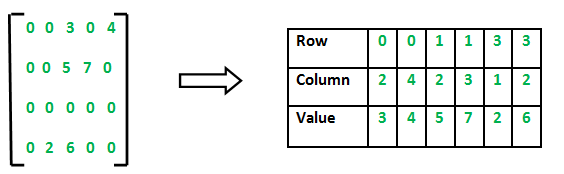

Matrices Dispersas

Importancia de las Representaciones Dispersas

En conjuntos de datos grandes, la mayoría de los elementos de la matriz pueden ser ceros. Por ejemplo, en matrices de conectividad de Internet o grafos de redes sociales, la mayoría de los nodos no están directamente conectados. Representar tales matrices en forma completa desperdicia memoria y aumenta el costo computacional.

Las matrices dispersas almacenan eficientemente solo los elementos no nulos:

\(A = \{ a_{ij} : a_{ij} \neq 0 \}\)

Las representaciones de matrices dispersas son ampliamente utilizadas en aprendizaje automático (por ejemplo, sistemas de recomendación) y simulaciones numéricas (por ejemplo, métodos de elementos finitos). Los algoritmos CSR o CSC permiten cálculos rápidos mientras ocupan un espacio de almacenamiento mínimo.

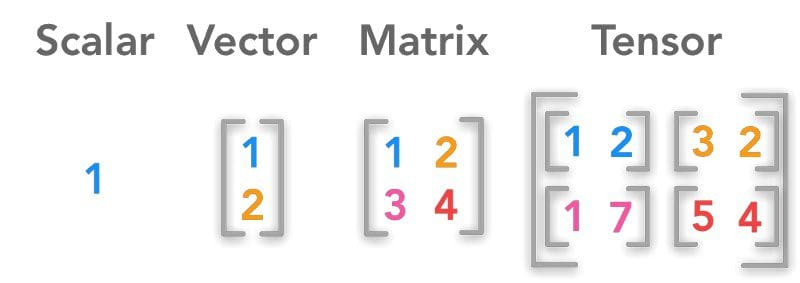

Matrices Tensoriales

Generalización de Matrices

Los tensores son una generalización de las matrices a dimensiones superiores. Mientras que una matriz es\(2D\)(\(m \times n\)), un tensor puede operar en\(k\)-dimensiones (\(n_1 \times n_2 \times \dots \times n_k\)). Por ejemplo, un tensor 3D se representa como\(T \in \mathbb{R}^{n \times m \times p}\).

Aplicaciones en Inteligencia Artificial

Los tensores se utilizan extensivamente en la IA, particularmente en marcos de aprendizaje profundo como TensorFlow y PyTorch, donde representan datos multidimensionales. Por ejemplo, durante la retropropagación en redes neuronales, los tensores almacenan:

1. Datos de Entrada: Para imágenes, un tensor podría ser\(\mathbb{R}^{B \times H \times W \times C}\), donde\(B\): tamaño del lote,\(H, W\): altura y ancho de la imagen,\(C\): canales (por ejemplo, RGB).

2. Pesos: Las capas de redes neuronales asignan tensores de peso para aprender patrones a partir de los datos.

Las técnicas de descomposición de tensores como CANDECOMP/PARAFAC se utilizan en sistemas de recomendación para entender patrones en datos de alta dimensión.

Preguntas Frecuentes sobre Matrices

Para aclarar más dudas comunes sobre matrices, esta sección responde algunas de las preguntas más frecuentes.

Preguntas Frecuentes Conceptuales

¿Qué es la Transpuesta de una Matriz?

La transpuesta de una matriz implica convertir sus filas en columnas y sus columnas en filas. Para una matriz \(A\):

\(A = \begin{bmatrix} 1 & 2 \\ 3 & 4 \end{bmatrix}, \quad A^T = \begin{bmatrix} 1 & 3 \\ 2 & 4 \end{bmatrix}\)

¿Cómo Identificar una Matriz Singular?

Una matriz es singular si no es invertible, es decir, \(\det(A) = 0\). Por ejemplo:

\(A = \begin{bmatrix} 1 & 2 \\ 2 & 4 \end{bmatrix}, \quad \det(A) = (1)(4) - (2)(2) = 0\)

Preguntas Frecuentes Prácticas

¿Por Qué Son Importantes las Matrices en los Videojuegos y la Animación?

Las matrices se pueden usar en motores de juegos para transformar objetos de manera efectiva y eficiente, como el movimiento de objetos, escalado y rotación. Además, permiten cálculos eficientes para efectos de iluminación en gráficos 3D.

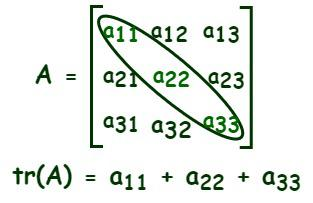

¿Qué es la Trazada de una Matriz?

La trazada de una matriz cuadrada se calcula como la suma de los elementos en su diagonal principal:

\(\text{tr}(A) = \sum_{i=1}^n a_{ii}\)

Por ejemplo, si:

\(A = \begin{bmatrix} 3 & 5 \\ 7 & 8 \end{bmatrix}, \quad \text{tr}(A) = 3 + 8 = 11\)

Conclusión

Las matrices son más que abstracciones matemáticas: proporcionan herramientas esenciales para organizar y procesar datos. Desde entender estructuras básicas de matrices como simétricas, diagonales y de identidad, hasta realizar operaciones como suma, multiplicación y transposición, ofrecen un marco incomparable para resolver problemas. Los determinantes y valores propios ofrecen una visión adicional, ayudando a revelar propiedades ocultas mientras se resuelven problemas del mundo real.

Más allá de sus usos clásicos, las matrices y sus extensiones modernas, como las matrices dispersas y los tensores, desempeñan un papel cada vez más vital en campos de vanguardia como la IA, visión por computadora y modelado financiero. El dominio de estas estructuras versátiles equipa a las personas con las habilidades analíticas necesarias para resolver algunos de los problemas más intrigantes de ciencia y tecnología; dominar matrices proporciona a las personas habilidades analíticas necesarias para resolver algunos de sus problemas más interesantes, ya sea modelando sistemas complejos o profundizando en el aprendizaje profundo; ¡el dominio continúa fomentando la innovación!